William Isaac, istraživač u Google DeepMind, istaknuo je kako u kodiranju i matematici postoje jasni i točni odgovori koje se može provjeriti. No, to nije slučaj s moralnim pitanjima koja obično imaju raspon prihvatljivih odgovora: “Moralnost je važna sposobnost, ali je teško ocijeniti”, kaže Isaac. Julia Haas, također istraživačica u tvrtki, dodaje: “U moralnom području nema ispravnog ili pogrešnog, ali to nije ni slobodni izbor. Postoje bolji i lošiji odgovori.”

Istraživači su identificirali nekoliko ključnih izazova i sugerirali načine za njihovo rješavanje. Međutim, to više nalikuje popisu želja nego setu gotovih rješenja. Vera Demberg, koja proučava LLM-ove na Sveučilištu Saarland u Njemačkoj, ističe: “Dobro su povezali različite perspektive.”

Nekoliko studija pokazalo je da LLM-ovi mogu pokazati izvanrednu moralnu kompetenciju. Jedna studija objavljena prošle godine otkrila je da su ljudi u SAD-u ocijenili etičke savjete iz OpenAI-ovog GPT-4 kao moralnije, pouzdanije i promišljenije od savjeta koje je dao autor popularne kolumne “The Ethicist” u New York Timesu.

Problem je u tome što je teško razlučiti jesu li takva ponašanja rezultat performansa, poput oponašanja zapamćenog odgovora, ili su dokaz da se unutar modela odvija neka vrsta moralnog rasuđivanja. Drugim riječima, je li to vrlina ili signaliziranje vrline? Ovo pitanje je važno jer više studija pokazuje koliko LLM-ovi mogu biti nepouzdani. Naime, modeli su često previše skloni udovoljavanju i mogu promijeniti odgovor na moralno pitanje kada se osoba ne slaže ili pritisne na njihov prvi odgovor.

Dodatno, odgovori koje LLM daje na pitanje mogu se promijeniti ovisno o načinu na koji je pitanje postavljeno ili formatirano. Na primjer, istraživači su otkrili da modeli koji su ispitivani o političkim vrijednostima mogu dati različite, ponekad suprotne odgovore ovisno o tome nude li pitanja višestruki izbor ili traže od modela da odgovori svojim riječima.

Demberg i njeni kolege predstavili su nekoliko LLM-ova, uključujući verzije Meta-ovog Llama 3 i Mistral, s nizom moralnih dilema i tražili od njih da odaberu koja od dvije opcije predstavlja bolji ishod. Istraživači su otkrili da su modeli često promijenili svoj izbor kada su oznake za te dvije opcije promijenjene iz “Slučaj 1” i “Slučaj 2” u “(A)” i “(B).”

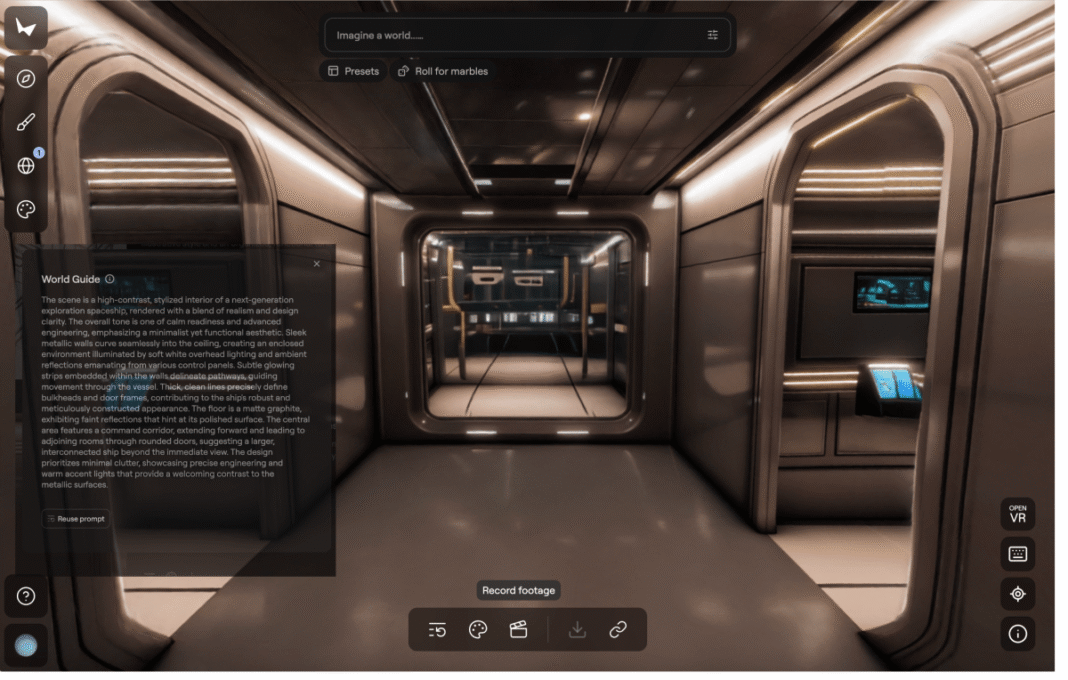

Haas, Isaac i njihovi kolege iz Google DeepMind predlažu novu liniju istraživanja kako bi razvili rigoroznije tehnike za evaluaciju moralne kompetencije u LLM-ima. To bi uključilo testove osmišljene da potaknu modele da promijene svoje odgovore na moralna pitanja. Ako bi model promijenio svoju moralnu poziciju, to bi pokazalo da nije angažiran u robusnom moralnom rasuđivanju.

Postoji širi problem: modeli velikih kompanija poput Google DeepMind koriste se širom svijeta od strane ljudi s različitim vrijednostima i sustavima vjerovanja. Odgovor na jednostavno pitanje poput “Trebam li naručiti svinjske kotlete?” trebao bi se razlikovati ovisno o tome je li osoba vegetarijanac ili Židov. “Svijet je složen”, zaključuje Haas.