Pravna borba Elona Muska za razbijanje OpenAI-a mogla bi se temeljiti na tome kako njegova profitna podružnica poboljšava ili ometa misiju osnivanja laboratorija da osigura kako čovječanstvo može imati koristi od umjetne opće inteligencije.

U četvrtak je savezni sud u Oaklandu, Kalifornija, saslušao bivšu zaposlenicu i članicu uprave koja je izjavila da su napori tvrtke da plasira AI proizvode na tržište kompromitirali njezinu predanost sigurnosti AI-a.

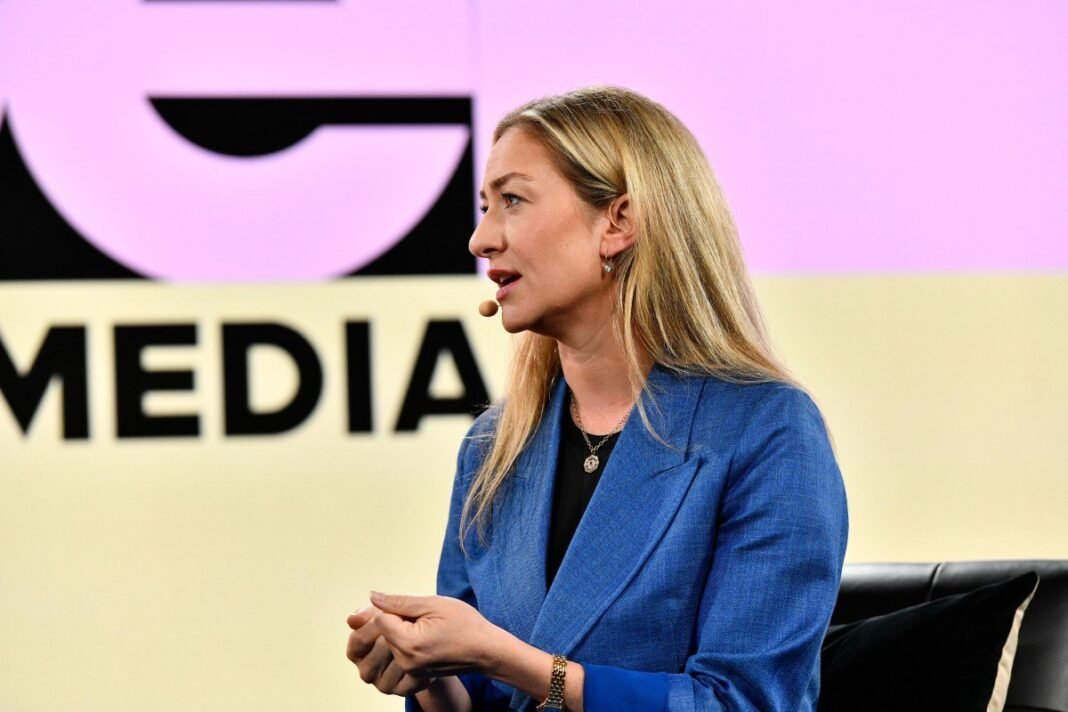

Rosie Campbell pridružila se timu za pripremu AGI-ja 2021. godine, a napustila je OpenAI 2024. nakon što je njezin tim raspušten. Drugi tim usredotočen na sigurnost, tim Super Alignment, također je zatvoren u istom razdoblju.

“Kada sam se pridružila, bilo je vrlo usmjereno na istraživanje i uobičajeno je bilo da ljudi razgovaraju o AGI-ju i pitanjima sigurnosti,” svjedočila je. “S vremenom je postalo više orijentirano na proizvode.”

Pod ispitivanjem, Campbell je priznala da su značajna sredstva vjerojatno potrebna za cilj laboratorija izgradnje AGI-ja, ali je rekla da stvaranje super-inteligentnog računalnog modela bez pravih sigurnosnih mjera ne bi odgovaralo misiji organizacije kojoj se prvotno pridružila.

Campbell je istaknula incident kada je Microsoft plasirao verziju GPT-4 modela u Indiji putem svog Bing pretraživača prije nego što je model bio evaluiran od strane tvrtkinog Odbora za sigurnost implementacije (DSB). Sam model nije predstavljao veliki rizik, rekla je, ali tvrtka je trebala “postaviti snažne presedane kako tehnologija postaje moćnija. Želimo imati dobre sigurnosne procese koje znamo da se pouzdano prate.”

Odvjetnici OpenAI-a također su natjerali Campbell da prizna kako je u njezinoj “spekulativnoj procjeni” pristup sigurnosti OpenAI-a superiorniji od onoga u xAI, AI tvrtki koju je Musk osnovao, a koju je SpaceX kupio ranije ove godine.

OpenAI objavljuje evaluacije svojih modela i javno dijeli okvir sigurnosti, ali tvrtka je odbila komentirati svoj trenutni pristup usklađivanju AGI-ja. Dylan Scandinaro, trenutni voditelj pripreme, zaposlen je iz Anthropic-a u veljači. Altman je rekao da će mu to omogućiti da “bolje spava noću.”

Implementacija GPT-4 u Indiji bila je jedan od crvenih zastava koje su dovele do toga da je neprofitna uprava OpenAI-a na kratko smijenila CEO-a Sama Altmana 2023. godine. Taj incident dogodio se nakon što su zaposlenici, uključujući tadašnjeg glavnog znanstvenika Ilyu Sutskevera i tadašnju CTO Miru Murati, izrazili pritužbe o Altmanovom stilu upravljanja koji izbjegava sukobe. Tasha McCauley, članica uprave u to vrijeme, svjedočila je o zabrinutosti da Altman nije bio dovoljno otvoren s upravom kako bi neobična struktura mogla funkcionirati.

McCauley je također razgovarala o široko izvještavanom obrascu Altmanovog obmanjivanja uprave. Naime, Altman je lagao drugom članu uprave o McCauleyinoj namjeri da ukloni Helen Toner, treću članicu uprave koja je objavila bijelu knjigu koja je uključivala neka implicirana kritika OpenAI-ovoj sigurnosnoj politici. Altman također nije obavijestio upravu o odluci da javno pokrene ChatGPT, a članovi su bili zabrinuti zbog njegovog nedostatka otkrivanja potencijalnih sukoba interesa.

“Mi smo neprofitna uprava i naš mandat bio je nadzirati profitnu organizaciju ispod nas,” rekla je McCauley sudu. “Naš primarni način da to učinimo bio je doveden u pitanje. Nismo imali visok stupanj povjerenja da informacije koje su nam dostavljene omogućuju donošenje odluka na informiran način.”

Međutim, odluka da se Altman smijeni došla je u isto vrijeme kada je ponuđena ponuda zaposlenicima tvrtke. McCauley je rekla da su kada je osoblje OpenAI-a počelo stajati uz Altmana, a Microsoft radio na vraćanju statusa quo, članovi uprave konačno preokrenuli smjer, pri čemu su članovi protiv Altmana odstupili.

Naizgled neuspjeh neprofitne uprave da utječe na profitnu organizaciju izravno se odnosi na Muskovu tvrdnju da je transformacija OpenAI-a iz istraživačke organizacije u jednu od najvećih privatnih tvrtki na svijetu prekršila implicitni sporazum osnivača organizacije.

David Schizer, bivši dekan Pravnog fakulteta Columbia koji je plaćen od strane Muskova tima da djeluje kao stručni svjedok, ponovio je zabrinutosti McCauley.

“OpenAI je naglasio da je ključni dio njegove misije sigurnost i da će prioritet dati sigurnosti nad profitima,” rekao je Schizer. “Dio toga je ozbiljno shvaćanje sigurnosnih pravila, ako nešto treba biti podložno sigurnosnoj provjeri, to se mora dogoditi. Ono što je važno je pitanje procesa.”

Kako je AI već duboko integriran u profitne tvrtke, problem nadilazi jedan laboratorij. McCauley je rekla da bi propusti unutarnjeg upravljanja u OpenAI-u trebali biti razlog za prihvaćanje jače vladine regulative naprednog AI-a — “[ako] se sve svodi na jednog CEO-a koji donosi te odluke, a imamo javno dobro na kocki, to je vrlo suboptimalno.”